Data

Customer 360

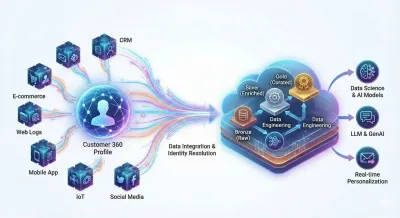

Vytvoření unifikovaného Customer 360 profilu není jen marketingový cíl, ale komplexní architektonická výzva. Tento článek analyzuje nezbytný přechod na architekturu Data Lakehouse v ekosystému Microsoft Fabric a Azure. Zjistěte, jak vybudovat moderní datovou platformu, která slouží jako robustní základna pro pokročilou cloudovou analytiku a hyper-personalizaci komunikace s využitím AI a LLM.

Google Analytics 4 v. On-premise alternativy

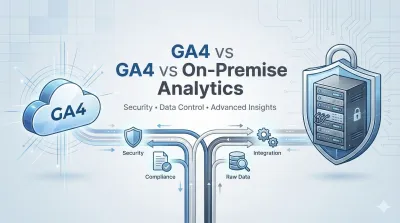

Přechod na Google Analytics 4 přinesl moderní eventový model a rychlé nasazení, v enterprise prostředí ale často naráží na limity datové suverenity, bezpečnosti a práce s detailními daty v dlouhém horizontu. Článek porovnává GA4 s on-premise a privátně nasaditelnými alternativami (např. Matomo, Piwik PRO) a ukazuje, kdy dává smysl zvolit vlastní provoz, hybridní architekturu nebo plnohodnotnou enterprise platformu. Zaměřuje se na kontrolu datových toků, přístup k raw datům, integraci do DWH/lakehouse a napojení na BI, Data Science a AI scénáře v rámci firemní datové platformy.

DirectLake v Power BI – přímý přístup k datům bez duplikace

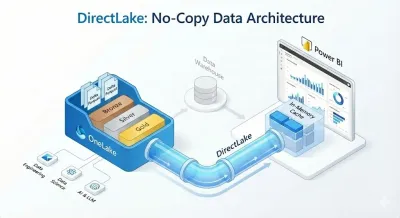

DirectLake posouvá Power BI do bodu, kdy už nemusíte dělat bolestivý kompromis mezi rychlostí importu a aktuálností DirectQuery. Data se čtou přímo z OneLake v Microsoft Fabricu, bez zbytečné duplikace do datového modelu a bez dlouhých plánovaných refreshů, které často brzdí práci s velkými datasety. Výsledkem je interaktivita blízká import módu, ale s výrazně čerstvějšími daty a jednodušší architekturou „jednoho zdroje pravdy“. V článku si vysvětlíme, jak DirectLake technicky funguje nad Delta tabulkami, kde typicky přináší největší výkonový a nákladový efekt a jak se liší od DirectQuery z pohledu latence, zátěže infrastruktury i provozních rizik v enterprise prostředí.

DataOps a automatizace datových pipeline

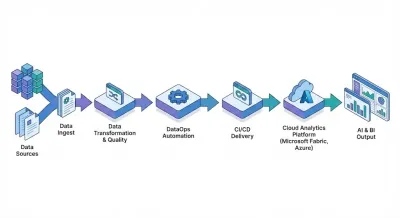

DataOps přenáší principy DevOps do datové oblasti: standardizuje a automatizuje vývoj i provoz datových pipeline od ingestu přes transformace a kontroly kvality až po řízené nasazení. Výsledkem je rychlejší dodávka datových výstupů, vyšší spolehlivost, auditovatelnost a znovupoužitelnost řešení. V článku ukazujeme, jak tento přístup prakticky realizovat na technologiích Microsoft a Azure – včetně CI/CD, lakehouse architektury a monitoringu kvality dat.

Data Mesh v praxi: Implementace pomocí domén

Data Mesh přináší do velkých organizací nový způsob práce s daty: odpovědnost za datové produkty se přesouvá z centrálního týmu přímo do jednotlivých domén, které data nejlépe znají. Článek vysvětluje, jak v praxi nastavit doménové vlastnictví, federovanou governance a samoobslužnou datovou platformu, aby decentralizace nezničila jednotné standardy. Nechybí ani konkrétní doporučení technologií v ekosystému Microsoft Azure pro škálovatelnou a bezpečnou implementaci.

TOON: nový formát pro profesionální zápis promptů (a proč není jen „jiný JSON“)

Formát TOON (Token-Oriented Object Notation) je nový způsob zápisu strukturovaných dat navržený s ohledem na práci s LLM – zejména tam, kde prompty obsahují větší objem tabulkových vstupů nebo stav multiagentních systémů. Zachovává významovou kompatibilitu s JSON, ale zapisuje data úsporněji a čitelněji: méně syntaktického „šumu“, možnost tabulkového zápisu homogenních polí a přirozená práce s odsazením. Článek ukazuje, kdy TOON dává smysl jako profesionální formát pro prompty, kde naopak zůstává výhodnější JSON, a jaká rizika přináší novost standardu i omezenější ekosystém nástrojů.